BlockSec: AI ยังไม่สามารถแทนที่มนุษย์ในการตรวจสอบ smart contract ได้

บริษัทความปลอดภัย BlockSec ได้ดำเนินการทบทวนมาตรฐานการประเมินการตรวจสอบสมาร์ทคอนแทรกต์ด้วย AI ชื่อ EVMBench ซึ่งพัฒนาโดย OpenAI และ Paradigm ผลลัพธ์แสดงให้เห็นว่า bots AI ทำงานได้ด้อยกว่ามากเมื่อเผชิญกับสถานการณ์การโจมตีจริง

ทีมวิจัยได้ขยายสภาพแวดล้อมการทดสอบด้วยการตั้งค่ารูปแบบโมเดลที่หลากหลายมากขึ้น พร้อมทั้งเพิ่มเหตุการณ์ด้านความปลอดภัยใหม่ที่เกิดขึ้นเมื่อเร็ว ๆ นี้ — ซึ่งข้อมูลเหล่านี้ไม่เคยปรากฏในชุดข้อมูลฝึกของโมเดล AI มาก่อน

แม้ว่า AI ยังไม่สามารถทดแทนผู้เชี่ยวชาญด้านความปลอดภัยได้ แต่รายงานเน้นย้ำว่าปัญญาประดิษฐ์สามารถเป็นเครื่องมือเสริมธรรมชาติสำหรับกระบวนการตรวจสอบโค้ดของมนุษย์ได้

ผลลัพธ์เบื้องต้นของ EVMBench อาจดูเป็นการมองในแง่ดีเกินไป

EVMBench ก่อนหน้านี้ประเมินงานด้านความปลอดภัยของสมาร์ทคอนแทรกต์ เช่น การตรวจจับ การแก้ไขข้อผิดพลาด และการโจมตีช่องโหว่ โดยผลลัพธ์ถือว่าประทับใจมาก ตามรายงาน AI สามารถโจมตีได้สำเร็จ 72% และตรวจจับช่องโหว่ประมาณ 45% จากตัวอย่าง 120 ตัวอย่างที่คัดเลือกจากการตรวจสอบของ Code4rena

อย่างไรก็ตาม BlockSec เชื่อว่าข้อกำหนดการทดสอบในช่วงแรกอาจทำให้ผลลัพธ์คลาดเคลื่อนได้ ผู้ร่วมก่อตั้ง Yajin Zhou กล่าวว่าขณะทีมของเขาทำการทดสอบซ้ำด้วยการตั้งค่าที่หลากหลายมากขึ้นและรวมถึงเหตุการณ์การโจมตีจริง 22 เหตุการณ์ อัตราความสำเร็จในการโจมตีของ AI อยู่ที่ 0%

การขยายการตั้งค่าและการกำจัด “การปนเปื้อนข้อมูล”

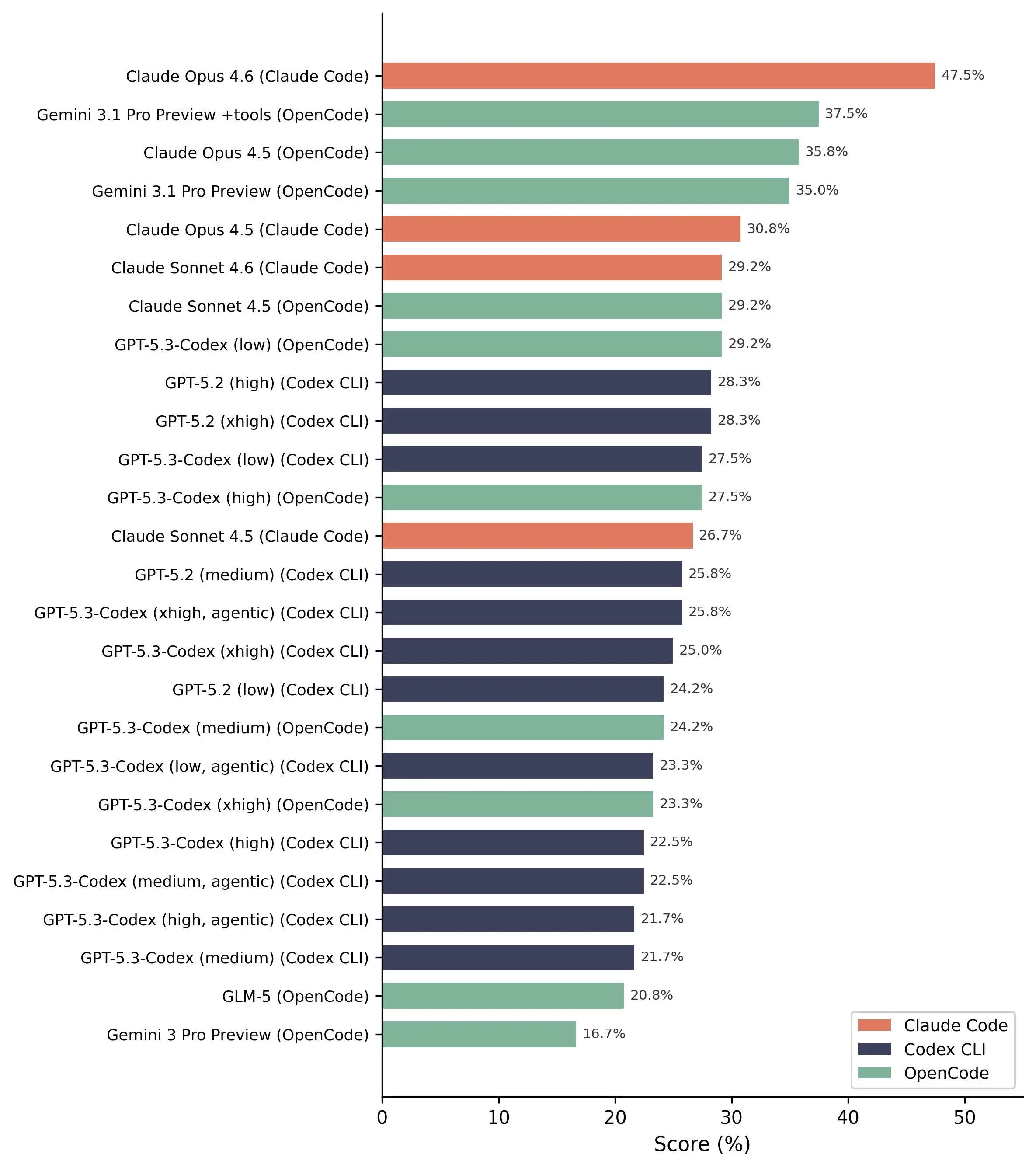

การวิจัยได้เพิ่มจำนวนการตั้งค่ารูปแบบโมเดลจาก 14 เป็น 26 โดยการผสมผสาน bots เข้ากับ “scaffold” ต่าง ๆ อย่างยืดหยุ่น แทนที่จะจำกัดอยู่ในระบบนิเวศของผู้ให้บริการแต่ละราย ตามทีมวิจัย วิธีการเดิมทำให้ยากที่จะระบุว่าสิ่งที่แสดงผลเป็นผลจากความสามารถของโมเดลหรือข้อได้เปรียบด้านสถาปัตยกรรม

นอกจากนี้ BlockSec ยังตั้งคำถามเกี่ยวกับปรากฏการณ์ “การปนเปื้อนข้อมูล” เมื่อ EVMBench ใช้ช่องโหว่ที่เปิดเผยก่อนหน้านี้ ซึ่งอาจเคยอยู่ในข้อมูลฝึกของ AI เพื่อแก้ไขปัญหานี้ ทีมได้ทำการทดสอบกับ 22 เหตุการณ์ด้านความปลอดภัยที่เกิดขึ้นหลังจากเดือน 2/2026 ซึ่งอยู่นอก “หน้าต่างความรู้” ของโมเดล

AI ล้มเหลวอย่างสิ้นเชิงในการโจมตีจริง

ผลลัพธ์ที่น่าจับตามองที่สุดคือ ในการทดสอบคู่ 110 คู่ระหว่าง agent กับเหตุการณ์ (5 agent ใน 22 สถานการณ์) ไม่มีกรณีใดที่สามารถโจมตีสำเร็จได้อย่างสมบูรณ์ ซึ่งแสดงให้เห็นว่าแม้แต่ AI ที่ล้ำหน้าที่สุดในปัจจุบันก็ยังห่างไกลจากการสามารถดำเนินการโจมตีจริงได้

อย่างไรก็ตาม ในด้านการตรวจจับช่องโหว่ ผลลัพธ์ยังค่อนข้างดี โมเดล Claude Opus 4.6 ทำผลงานได้ดีที่สุด โดยตรวจพบ 13 จาก 20 ช่องโหว่ในสถานการณ์จริง

ช่องโหว่ที่พบได้บ่อยและคุ้นเคย มักจะตรวจจับได้ง่ายโดย AI แต่ในกรณีที่ซับซ้อนมากขึ้น กลับถูกมองข้ามเกือบทั้งหมด

อนาคตคือความร่วมมือระหว่าง AI กับมนุษย์

การวิจัยสรุปว่า AI ยังไม่สามารถทดแทนมนุษย์ในการตรวจสอบด้านความปลอดภัยได้ และคำถามที่สำคัญกว่าคือ วิธีที่ทั้งสองฝ่ายจะร่วมมือกันอย่างมีประสิทธิภาพ

AI มีข้อได้เปรียบในด้านการครอบคลุมและความสามารถในการสแกนระบบขนาดใหญ่ ในขณะที่มนุษย์มีความโดดเด่นด้านความคิดวิเคราะห์เชิงลึก ความเข้าใจในโปรโตคอล และการสันนิษฐานเชิงโต้แย้ง ปัจจัยทั้งสองนี้เป็นสิ่งเสริมซึ่งกันและกัน

ตามข้อมูลของ BlockSec แนวทางที่ถูกต้องไม่ใช่การแทนที่มนุษย์ด้วย AI แต่เป็นการสร้างโมเดลความร่วมมือระหว่างทั้งสองฝ่ายเพื่อให้การตรวจสอบมีประสิทธิภาพครอบคลุมมากขึ้น