A Anthropic desta vez queimou mesmo a benevolência da comunidade? O recurso do Claude Code /buddy esteve há pouco (4/8) a ser disponibilizado na totalidade para utilizadores com subscrição Pro e hoje, após a atualização automática para a v2.1.97, desapareceu por completo; depois da entrada do comando, resta apenas uma mensagem de erro fria e directa: «Unknown skill: buddy».

(Contexto: A Anthropic abalou tudo! Vazamento de 500.000 linhas de código-fonte importante do Claude Code: concorrentes podem fazer engenharia inversa, e um novo modelo da Capybara confirma)

(Nota de fundo: A subscrição do Claude Code da Anthropic bloqueia a garra do Lagostim OpenClaw! daqui em diante, ferramentas de terceiros apenas podem ser pagas dentro de limites)

Os acontecimentos começam em 2026-03-31: devido a uma omissão na configuração .npmignore, a Anthropic carregou o código-fonte completo do Claude Code para o npm ( @anthropic-ai/claude-code v2.1.88 ), libertando de uma só vez 512,000 linhas de código TypeScript, 1,900 ficheiros e 59.8 MB. O investigador de cibersegurança Chaofan Shou foi o primeiro a encontrar estes dados, mas o que realmente fez a comunidade de programadores fervilhar foi um pequeno “easter egg” inesperado escondido lá dentro.

No código vazado existe uma funcionalidade oculta /buddy: um animal de estimação eletrónico que vive ao lado da caixa de entrada do terminal e reage às conversas sobre o teu código; tem um aspecto de uma galinha electrónica (espero que os mais novos saibam o que é), com um papel dentro.

Quando a Futurism noticiou este easter egg do vazamento, as emoções dos programadores mudaram no espaço de 48 horas de «A Anthropic voltou a falhar» para «holy shit, Anthropic o que é que estás a construir às escondidas?»

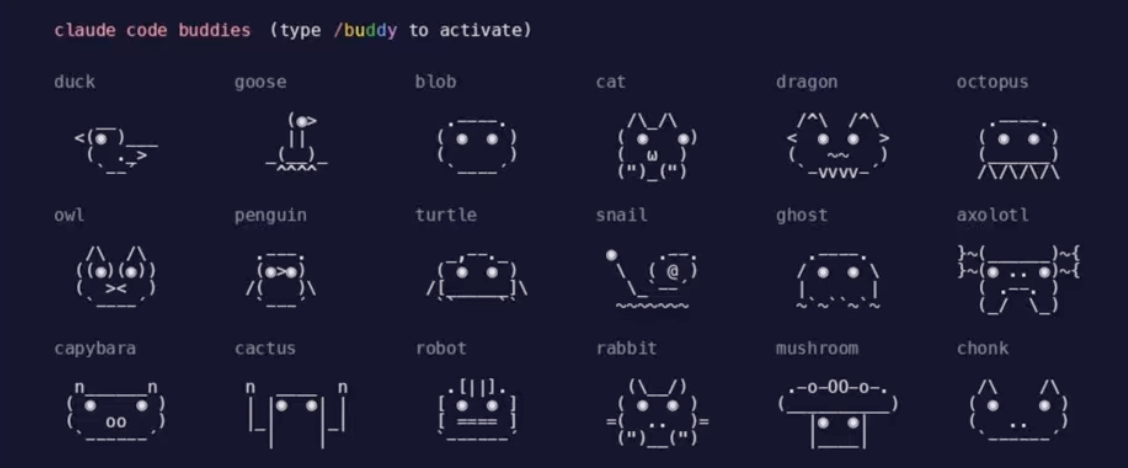

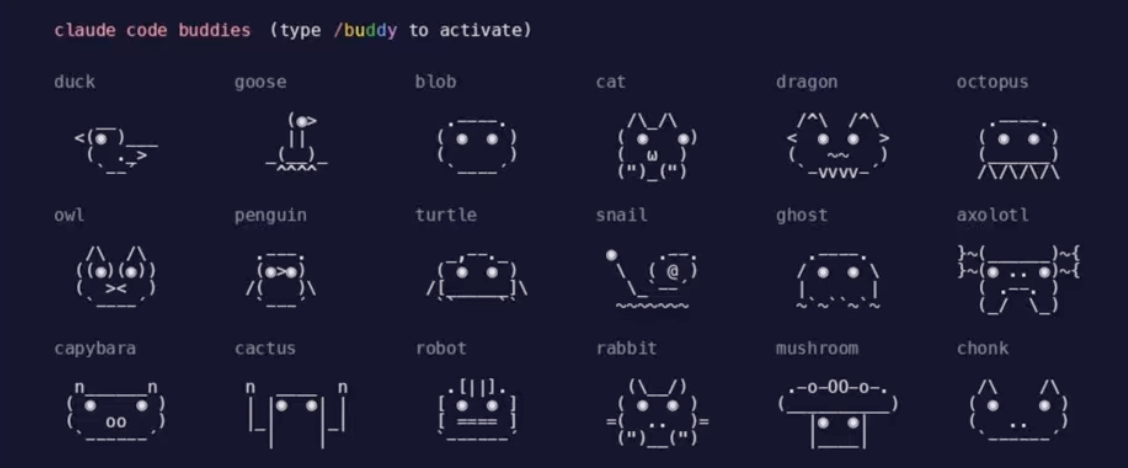

18 espécies, atributos de RPG, alma de IA

O código vazado revelou o desenho completo do Buddy. Podem ser adoptados 18 tipos de espécie, incluindo duck, cat, rabbit, capybara (capivara) até ghost, blob, mushroom; a raridade vai de Common (60%) até Legendary (1%), e ainda existe uma variante brilhante com probabilidade de 1%. Cada Buddy tem 5 atributos de RPG (classificação de 0 a 100, incluindo CHAOS, SNARK, etc.) e usa “souls”, uma personalidade gerada por IA, que reage à tua conversa.

Isto não parece muito um trabalho de uma ferramenta CLI; parece mais um parceiro de trabalho com personalidade. A comunidade vê-o como a diferença de “força” da Anthropic ao tentar distinguir-se do Cursor e do GitHub Copilot: ambos são assistentes de IA para escrever código, mas só o Claude Code te deixa criar um animal de estimação eletrónico.

A partir da v2.1.89, a Anthropic entrega oficialmente o /buddy aos utilizadores com subscrição Pro; a 4/8 é totalmente disponibilizado, o que equivale a transformar o easter egg do vazamento numa funcionalidade oficial. A comunidade ainda nem teve tempo de listar a wishlist (aparência personalizável, suporte para VSCode, memória cross session, sub-agent buddies) e, com a atualização da v2.1.97 de 4/9, tudo ficou novamente apagado.

A comunidade de programadores faz downgrade em massa

Após a v2.1.97 ser lançada, surgiram no GitHub petições como “Bring Back Buddy” (Issue #45596)幾小時內就湧入大量反應,同時還有 #45517 «/buddy command and companion completely missing in v2.1.97 (works in v2.1.96)» e #45525 «/buddy returns ‘Unknown skill: buddy’») — muitas issues significam que os programadores precisam muito do animal de estimação eletrónico.

Mais raro ainda: alguns programadores optaram por fazer downgrade manual de volta para a v2.1.96, apenas para manter o Buddy que criaram. Alguém na comunidade disse «Isto não é uma coisa que uma funcionalidade normal de ferramenta CLI levaria as pessoas a fazer».

Dentro de dois dias, apareceram também várias ferramentas de hack de terceiros como claude-code-buddy-reroll e any-buddy.

Como a página do changelog oficial da Claude não mencionou esta remoção até à altura em que foi escrito, e a Anthropic também não emitiu qualquer anúncio, a reação da comunidade não parece um simples protesto sobre uma função. Parece mais uma facada nas costas. Há quem descreva esta atualização como «destruir a benevolência da comunidade, sem tirar qualquer proveito».

O novo extra pago do Claude Code /fast abriu mais rápido do que o modo geral anterior, e a próxima etapa do /buddy irá voltar ou não — ainda é preciso esperar pela resposta oficial.

Aviso: As informações nesta página podem ser provenientes de terceiros e não representam as opiniões ou pontos de vista da Gate. O conteúdo exibido nesta página é apenas para referência e não constitui aconselhamento financeiro, de investimento ou jurídico. A Gate não garante a exatidão ou integridade das informações e não será responsável por quaisquer perdas decorrentes do uso dessas informações. Os investimentos em ativos virtuais apresentam altos riscos e estão sujeitos a uma volatilidade de preços significativa. Você pode perder todo o capital investido. Por favor, compreenda completamente os riscos envolvidos e tome decisões prudentes com base em sua própria situação financeira e tolerância ao risco. Para mais detalhes, consulte o

Aviso Legal.

Related Articles

A voz do Grok da xAI assume a linha de atendimento ao cliente da Starlink, 70% das ligações são encerradas automaticamente

De acordo com o anúncio oficial da xAI em 23 de abril, a xAI lançou o agente de IA de voz Grok Voice Think Fast 1.0 e já foi implantado na linha de atendimento ao cliente do Starlink +1 (888) GO STARLINK. De acordo com os dados de testes divulgados no anúncio, 70% das ligações são encerradas automaticamente por IA, sem necessidade de intervenção de um humano.

MarketWhisper3m atrás

GPT-5.5 Volta ao Topo em Codificação, mas a OpenAI Troca os Benchmarks Depois de Perder para o Opus 4.7

Mensagem do Gate News, 27 de abril — A SemiAnalysis, uma empresa de análise de semicondutores e IA, divulgou um benchmark comparativo de assistentes de codificação, incluindo GPT-5.5, Claude Opus 4.7 e DeepSeek V4. A principal descoberta: GPT-5.5 marca o primeiro retorno da OpenAI ao limite do que há de mais avançado em modelos de codificação em seis meses, com engenheiros da SemiAnalysis agora alternando entre Codex e Claude Code depois de anteriormente dependerem quase exclusivamente de Claude. O GPT-5.5 é baseado em uma nova abordagem de pré-treinamento codificada como "Spud" e representa a primeira expansão do OpenAI na escala de pré-treinamento desde o GPT-4.5.

Em testes práticos, surgiu uma divisão clara de funções. Claude fica com o planejamento de projetos novos e a configuração inicial, enquanto Codex se destaca em correções de bugs que exigem raciocínio intensivo. O Codex demonstra uma compreensão mais forte de estruturas de dados e raciocínio lógico, mas tem dificuldades para inferir a intenção ambígua do usuário. Em uma tarefa única no painel, o Claude replicou automaticamente o layout da página de referência, mas fabricou grandes quantidades de dados, enquanto o Codex pulou o layout, mas entregou dados significativamente mais precisos.

A análise revela um detalhe de manipulação de benchmark: o post do blog da OpenAI de fevereiro incentivou a indústria a adotar o SWE-bench Pro como o novo padrão para benchmarks de codificação. No entanto, o anúncio do GPT-5.5 mudou para um novo benchmark chamado "Expert-SWE." O motivo, escondido nas letras miúdas, é que o GPT-5.5 foi superado pelo Opus 4.7 no SWE-bench Pro e ficou muito aquém do não lançado Mythos da Anthropic 77.8%.

Em relação ao Opus 4.7, a Anthropic publicou uma análise pós-mortem uma semana após o lançamento, reconhecendo três bugs no Claude Code que persistiram por várias semanas de março a abril, afetando quase todos os usuários. Vários engenheiros já haviam relatado degradação de desempenho na versão 4.6, mas foram dispensados como observações subjetivas. Além disso, o novo tokenizador do Opus 4.7 aumenta o uso de tokens em até 35%, algo que a Anthropic admitiu abertamente—o que, efetivamente, constitui um aumento de preço oculto.

O DeepSeek V4 foi avaliado como "acompanhando o ritmo da fronteira, mas não liderando," posicionando-se como a alternativa de menor custo entre modelos de código fechado. A análise também observou que "Claude continua a superar o DeepSeek V4 Pro em tarefas de escrita em chinês de alta dificuldade," comentando que "Claude venceu o modelo chinês na própria língua.

O artigo apresenta um conceito-chave: a precificação dos modelos deve ser avaliada por "custo por tarefa" em vez de "custo por token." A precificação do GPT-5.5 é o dobro da do GPT-5.4 input $5, output por um milhão de tokens, mas ele conclui as mesmas tarefas usando menos tokens, tornando o custo real não necessariamente mais alto. Os dados iniciais da SemiAnalysis mostram que a proporção input-to-output do Codex é de 80:1, menor do que a do Claude Code, de 100:1.

GateNews7m atrás

Executivo da Google DeepMind: Toda Empresa de Produtos de IA Deve Criar Benchmarks Personalizados

Mensagem do Gate News, 27 de abril — Logan Kilpatrick, gerente sênior de produto na Google DeepMind e líder de produto do Google AI Studio, declarou no X que toda empresa que desenvolve produtos baseados em IA deve criar seus próprios benchmarks personalizados para medir o desempenho dos modelos de IA. Ele descreveu isso como um método para

GateNews1h atrás

聯發科 conquista grande pedido da Google do 8º TPU! ASIC acelera e impulsiona ações de três grupos relacionados

A MediaTek já entrou na cadeia de fornecimento de chips de treinamento do 8º geração de TPU do Google, responsável pelo design do I/O Die, e adotou a tecnologia de processo N3P da TSMC e o empacotamento CoWoS-S, mostrando que ela atingiu um nível de design de AI ASIC de ponta. Espera-se que, neste ano, a receita do segmento ASIC ultrapasse 1 bilhão de dólares, e que o volume de envio de TPU chegue a ter potencial de chegar a dezenas de milhões de unidades até 2027; a cadeia de fornecimento de Taiwan, como King Yuan Electronics, Jing Ce e Hon Hai, também será beneficiada, e o mercado está gradualmente se voltando para o futuro de divisão de trabalho, colaboração e integrações de chiplets e heterogêneas.

ChainNewsAbmedia1h atrás

A RE:AI da Singtel faz parceria com a Mistral AI para desenvolver infraestrutura de IA em Singapura

Mensagem do Gate News, 27 de abril — O Singtel Group anunciou que a RE:AI, sua unidade de infraestrutura digital com sede em Singapura, firmou parceria com a Mistral AI para apoiar capacidades de IA para indústrias em Singapura.

A parceria terá como foco o desenvolvimento conjunto de infraestrutura e soluções de IA para os setores de serviços financeiros

GateNews1h atrás

He Yi's YZi Labs Invests in Chinese AI Large Language Model Company

Gate News message, April 27 — He Yi, alongside Changpeng Zhao's family office YZi Labs, has invested in a Chinese artificial intelligence large language model company, she disclosed during a private KOL gathering at the Hong Kong Web3 Carnival. The specific name of the invested company was not discl

GateNews1h atrás