L’IA code et fait n’importe quoi ! L’application des produits à rotation rapide des supermarchés en temps réel « Chasseur anti-gaspillage » révèle des problèmes de sécurité informatique : le GPS de votre maison se met à nu

Récemment, une application générée par l’IA, prétendant intégrer une carte des produits proches de la date de péremption des supermarchés taiwanais, a fait l’objet de problèmes de sécurité liés à la fuite des GPS des utilisateurs. Des entreprises comme Amazon ont également récemment connu d’énormes pannes et des pertes de 1,78 million de dollars dues à une dépendance à l’IA pour écrire des programmes, soulignant la nécessité absolue d’un contrôle par des ingénieurs humains.

L’application “Chasseur de Nourriture” intègre les produits proches de la date de péremption des supermarchés, soulevant des questions sur l’autorisation de l’API

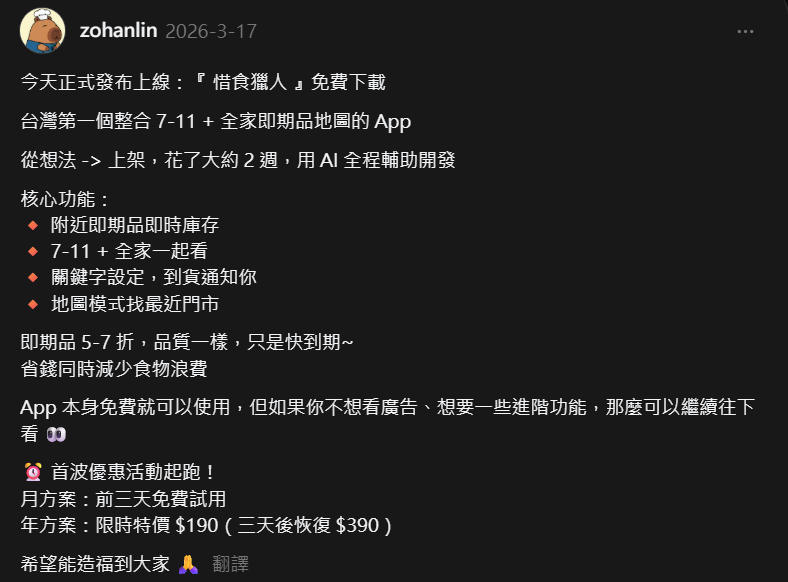

Une personne se présentant comme spécialisée dans le développement de produits IA et la croissance d’IP personnelle a récemment annoncé sur la plateforme Threads le lancement de l’application “Chasseur de Nourriture”, se vantant de pouvoir intégrer une carte des produits proches de la date de péremption de 7-11 et de FamilyMart, dont la fonction principale est la recherche en temps réel des stocks à proximité ainsi que les notifications de disponibilité par mots-clés.

Le développeur a indiqué que l’application Chasseur de Nourriture a été entièrement développée avec l’aide de l’IA, prenant environ 2 semaines. Bien qu’elle soit proposée en téléchargement gratuit avec des fonctionnalités de base, un plan payant a également été lancé pour supprimer les publicités et offrir des fonctionnalités avancées, incluant une offre spéciale de 190 dollars pour un abonnement annuel.

Ce post a déjà attiré 12 000 vues sur Threads, mais a également suscité des doutes chez plusieurs internautes concernant la légitimité de son autorisation API.

Un internaute a mis en doute si l’application Chasseur de Nourriture avait obtenu l’autorisation officielle de l’API et a averti que si elle récupérait des données sans autorisation, la seule modification des paramètres du Token par le supermarché officiel pourrait rendre les fonctionnalités inopérantes.

Un autre internaute a analysé sous l’angle de la concurrence commerciale, indiquant que les supermarchés taïwanais considèrent ces dernières années le nombre d’abonnés à l’application comme un indicateur de performance clé, intégrant les données de stock des produits proches de la date de péremption dans le système afin d’augmenter le nombre d’abonnés et le taux d’utilisation. Si une application tierce divise le trafic et entre en conflit avec les intérêts officiels, elle risque fortement d’être bloquée par ces derniers.

Actuellement, des internautes ont déjà envoyé des informations pertinentes aux autorités officielles, mais jusqu’à la rédaction de cet article le 27 mars au matin, 7-11 et FamilyMart n’avaient pas encore publié de commentaires concernant l’application Chasseur de Nourriture.

Un ingénieur révèle des problèmes de sécurité de l’application Chasseur de Nourriture, exposant les coordonnées GPS de chez soi

En plus des controverses sur l’autorisation de l’API, l’application Chasseur de Nourriture soulève également des préoccupations en matière de sécurité.

Yi-Jyun Pan, ingénieur chez Zeabur.app, a récemment publié des avertissements, incitant le public à cesser d’utiliser l’application Chasseur de Nourriture.

Il a indiqué que dès que vous utilisez cette application et partagez votre position, vos coordonnées GPS exactes à domicile seront enregistrées dans une base de données, puis malheureusement exposées sur le web.

Bien que le développeur ait tenté de corriger le problème sur la base de ces recommandations, après une nouvelle vérification, Yi-Jyun Pan a découvert que le développeur n’avait réparé qu’à moitié, et que les risques de sécurité demeuraient.

Yi-Jyun Pan a souligné qu’étant donné que c’est un produit généré par l’IA, la protection du système est extrêmement insuffisante. Si les utilisateurs craignent des problèmes de sécurité, ils doivent suivre les étapes appropriées avant de supprimer l’application Chasseur de Nourriture, ils doivent d’abord supprimer tous les enregistrements de suivi par mots-clés et de magasins suivis, afin que les informations de coordonnées correspondantes soient synchronisées et supprimées, puis désinstaller l’application.

Yi-Jyun Pan a également donné trois conseils au développeur, d’abord que l’application est un front et non un back-end, et que si l’on s’appuie uniquement sur le front-end pour protéger les ressources, cela ne peut pas être considéré comme une protection, la politique de confidentialité doit également être documentée de manière détaillée. Le développeur ne doit absolument pas faire confiance aveuglément aux méthodes de l’IA, la logique commerciale doit encore s’appuyer sur un contrôle humain.

L’IA pour écrire des programmes devient une arme à double tranchant, Amazon et Moonwell paient un prix élevé

Une dépendance excessive à l’IA pour écrire des programmes, sans révision, conduit souvent à des catastrophes, même les grandes entreprises ne peuvent y échapper.

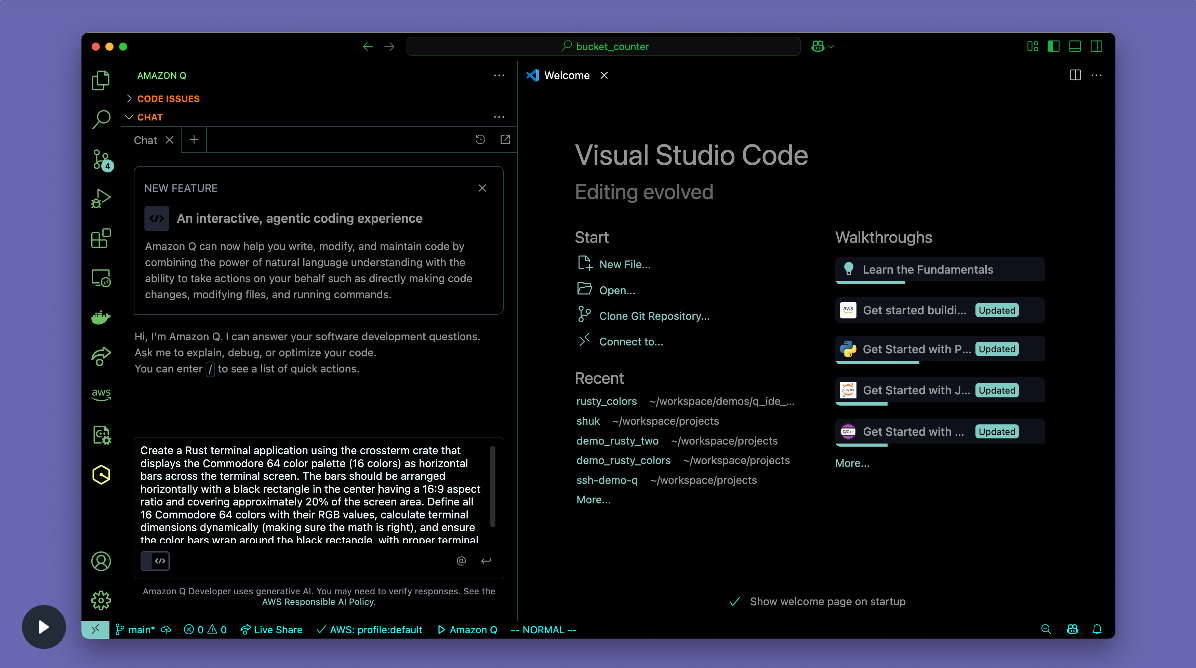

Récemment, le Business Insider a rapporté qu’Amazon a connu une grave interruption de système sur son site e-commerce en mars 2026, une enquête interne attribuant “une partie de la responsabilité” à l’assistant de code IA d’Amazon : Amazon Q Developer.

Dave Treadwell, vice-président senior des services de commerce électronique chez Amazon, a indiqué dans un document interne que depuis le troisième trimestre 2025, la fréquence des événements a montré une tendance à la hausse. L’anomalie du 2 mars a entraîné des erreurs d’affichage des délais de livraison, provoquant la perte d’environ 120 000 commandes et 1,6 million d’erreurs sur le site.

Amazon a donc annoncé la mise en œuvre d’une réinitialisation de sécurité de 90 jours, exigeant que les ingénieurs obtiennent une révision à deux personnes avant de modifier le code.

Source de l’image : Assistant de code IA d’Amazon : Amazon Q Developer

Le secteur de la finance décentralisée (DeFi) sur la blockchain fait également face aux mêmes défis. Le célèbre protocole de prêt Moonwell a connu une erreur de configuration d’oracle en février, entraînant une chute des prix des jetons, provoquant des robots de liquidation et entraînant une perte de 1,78 million de dollars.

Un comptable en sécurité blockchain, Pashov, a examiné le projet et a découvert que le code à l’origine de la faille avait été réalisé en collaboration avec le modèle IA Claude Opus 4.6.

Avec la montée en popularité des outils de programmation IA comme Claude Code et Codex, leur commodité apporte également un aspect à double tranchant.

Les cas ci-dessus montrent que même si l’IA générative peut accélérer la vitesse de développement, en raison d’un manque de logique rigoureuse dans le mode de génération intuitive, sans le contrôle humain, cela peut entraîner des pertes irréparables pour les entreprises et les utilisateurs.

Lecture complémentaire :

Un professeur de l’Université de Californie analyse l’IA générative : le Vibe Coding n’est pas si impressionnant ? Quelle est la meilleure façon d’utiliser l’IA pour écrire des programmes ?