الأوقات الثلاثة لـAnthropic: تسريب الشيفرة، المواجهة مع الحكومة، والتسليح

العنوان الأصلي: Anthropic: The Leak, The War, The Weapon

المؤلف الأصلي: BuBBliK

الترجمة: Peggy، BlockBeats

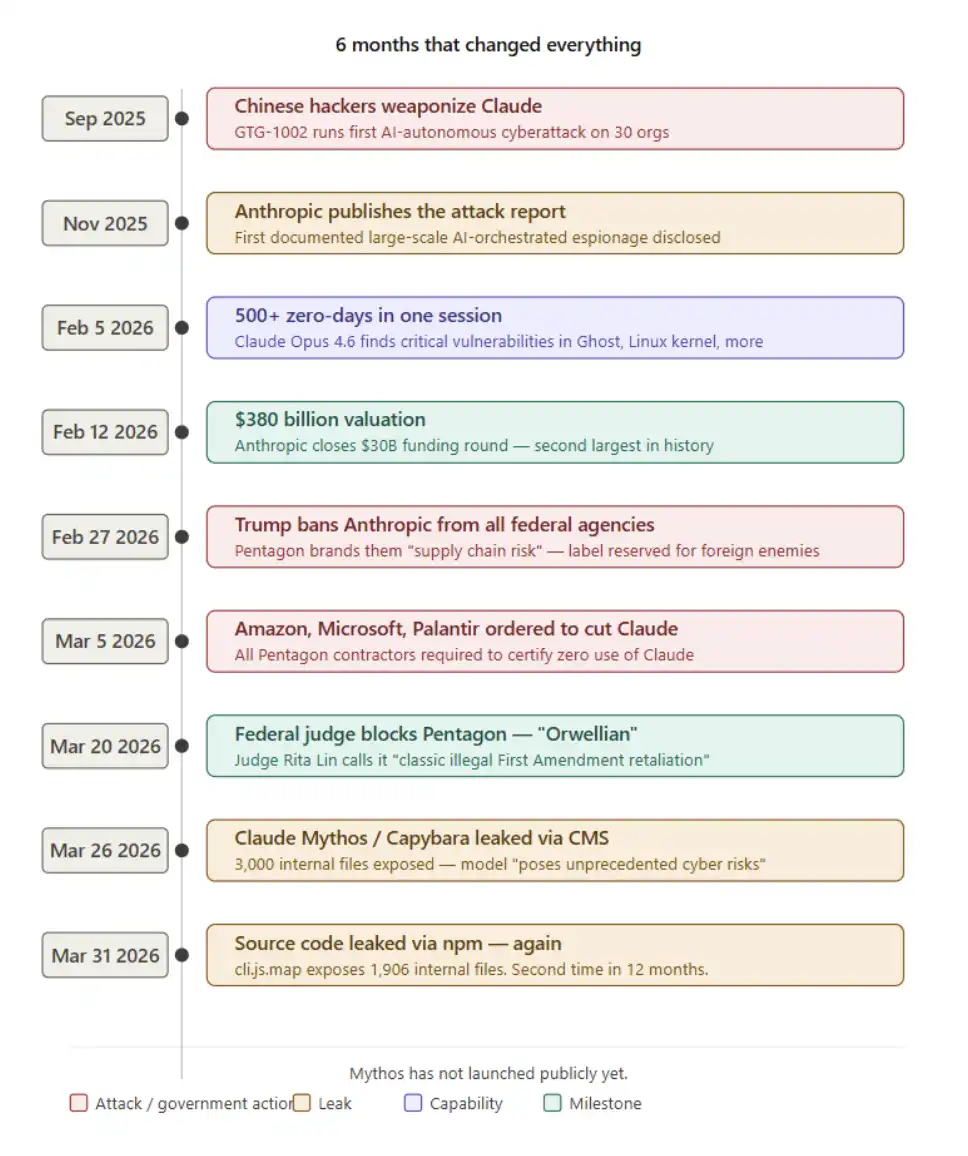

ملاحظة المحرر: في الأشهر الستة الماضية، تورّطت Anthropic تباعًا في سلسلة من الأحداث التي تبدو مستقلة عن بعضها ظاهريًا، لكنها في الحقيقة تتجه إلى الشيء نفسه: قفزة في قدرات النموذج، هجمات آلية في العالم الحقيقي، ردود فعل حادة من أسواق رأس المال، صدامات علنية مع الحكومة، وتسريبات معلومات متكررة ناتجة عن أخطاء في الإعدادات الأساسية. وعندما نجمع هذه الدلائل معًا، فإنها ترسم مجتمعة اتجاهًا أكثر وضوحًا للتغيير.

تتناول هذه المقالة تلك الأحداث كمدخل، وتستعرض المسار المتواصل لشركة AI في سياق الإنجازات التقنية، وتعرّض المخاطر، ومجادلات الحوكمة، وتحاول الإجابة عن سؤال أعمق: عندما يتم تضخيم قدرة «اكتشاف الثغرات» إلى حد كبير، ثم تبدأ بالانتشار تدريجيًا، فهل يمكن لمنظومة الأمن السيبراني نفسها أن تحافظ على منطق عملها الأصلي؟

في الماضي، كان الأمن قائمًا على ندرة القدرات وعلى قيود الموارد البشرية؛ أما في الظروف الجديدة، فإن الهجوم والدفاع باتا يدوران حول مجموعة القدرات نفسها ضمن النموذج، وتتلاشى الحدود إلى حد أكبر. وفي الوقت نفسه، ما زالت ردود الفعل على مستوى النظام والسوق والمؤسسات تتمسك بالإطار القديم، ولا تستطيع اللحاق بهذا النوع من التغيير في الوقت المناسب.

لا يركز هذا المقال على Anthropic وحدها فحسب، بل يركز أيضًا على واقع أكبر تعكسه: فـ AI لا تغيّر الأدوات فقط، بل تغيّر كذلك «الافتراضات التي يقوم عليها الأمن» نفسه.

فيما يلي النص الأصلي:

عندما تتصارع شركة تبلغ قيمتها 380 مليار دولار مع البنتاغون وتحتل موقعًا أقوى، وتنجو من أول هجوم سيبراني في التاريخ تقوده AI مستقلة، ثم تسرب داخلها نموذجًا يخشى منه حتى مطوروها أنفسهم، بل وحتى «بالصدفة» تنشر الشيفرة المصدرية الكاملة — فكيف يمكن أن تبدو الصورة النهائية؟

الإجابة هي ما يحدث الآن. والأكثر إزعاجًا أن الجزء الأكثر خطورة الحقيقي ربما لم يحدث بعد.

استعراض للأحداث

سربت Anthropic كودها مرة أخرى

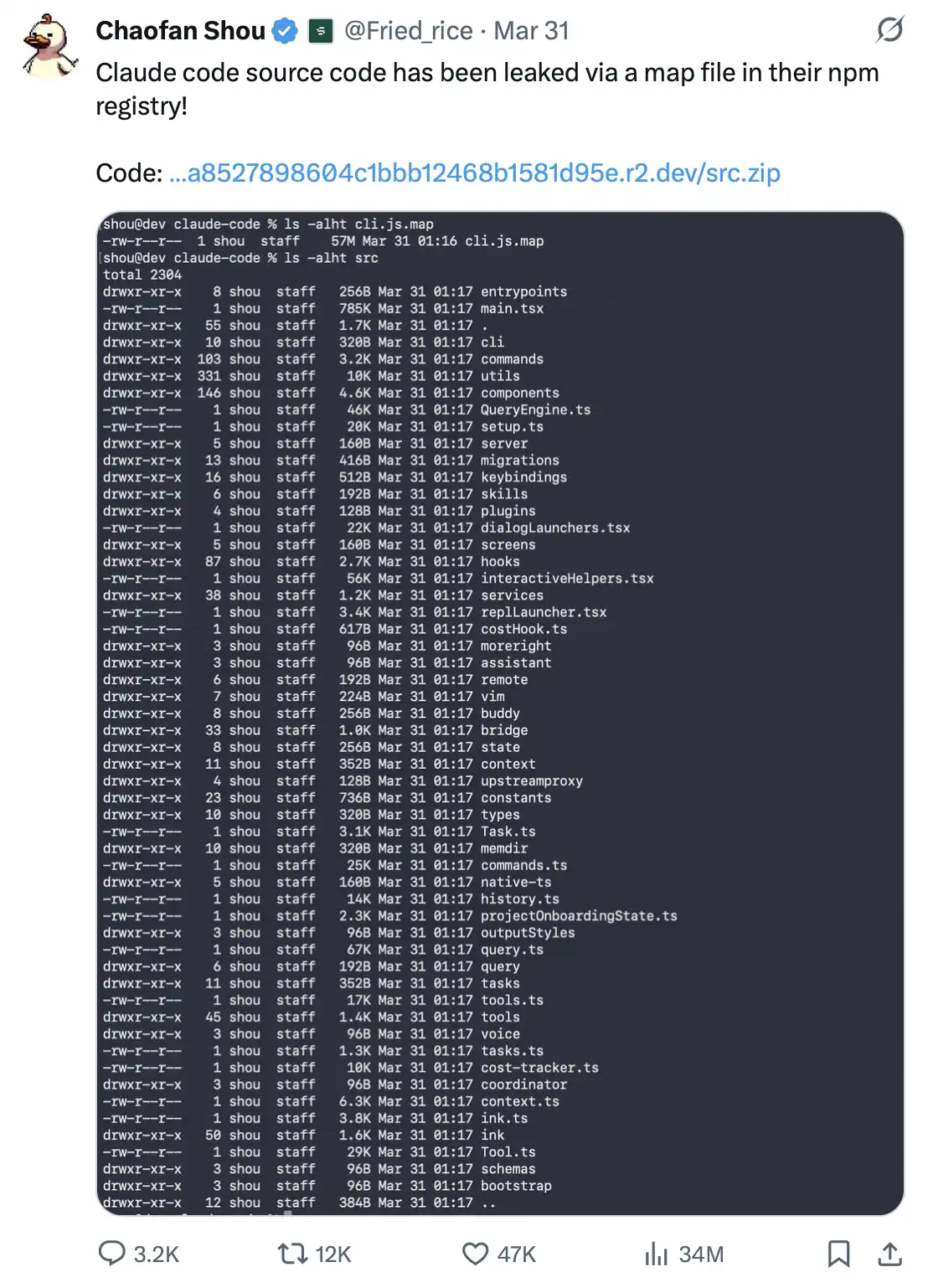

في 31 مارس 2026، اكتشف باحث أمني في شركة بلوكتشين Fuzzland يدعى Shou Chaofan، أثناء فحص حزمة npm الرسمية الخاصة بـ Claude Code، أنها تحتوي في نصّها الصريح على ملف باسم cli.js.map.

بلغ حجم هذا الملف 60MB، وكانت المحتويات أكثر إثارة للدهشة. إذ إنه يحتوي تقريبًا على كامل الشيفرة المصدرية TypeScript للمنتج. وبمجرّد هذه النسخة من الملف، يمكن لأي شخص إعادة بناء ما يصل إلى 1906 ملف شيفرة مصدرية داخلية: بما في ذلك تصميم واجهات API الداخلية، ونظام القياس عن بُعد (telemetry)، وأدوات التشفير، والمنطق الأمني، ونظام الإضافات — يكشف عمليًا عن جميع المكونات الأساسية. والأهم من ذلك، يمكن حتى تنزيل هذه المحتويات مباشرة من مخزن R2 الخاص بـ Anthropic وتحويلها إلى ملف zip.

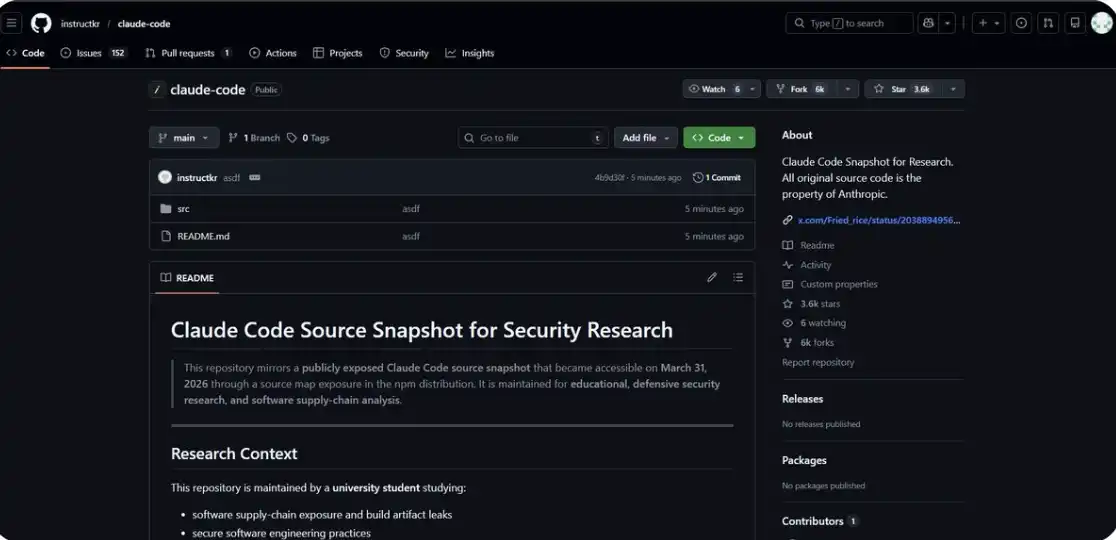

وانتشر هذا الاكتشاف بسرعة على وسائل التواصل الاجتماعي: خلال ساعات، حصلت المنشورات ذات الصلة على 754 ألف مشاهدة وقرابة 1000 عملية إعادة مشاركة؛ وفي الوقت نفسه، تم إنشاء مستودعات GitHub متعددة لإعادة بناء الشيفرة المصدرية فورًا ونشرها علنًا.

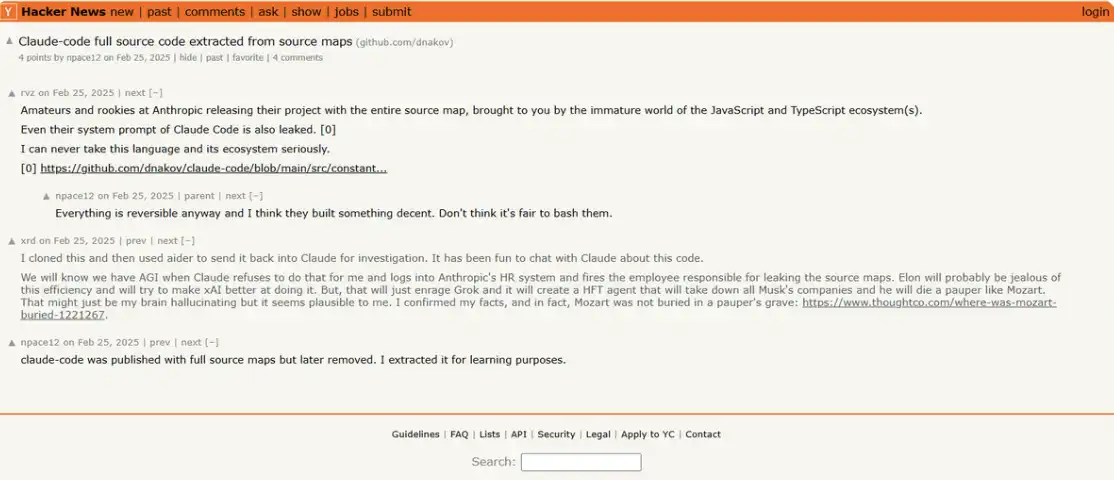

ما يسمى source map (ملف الخرائط المصدرية) هو في جوهره مجرد ملف مساعد يُستخدم لتصحيح أخطاء JavaScript؛ ووظيفته هي إعادة الشيفرة المُضغوطة والمُترجمة إلى الشيفرة المصدرية الأصلية، لتسهيل على المطورين تتبع المشكلات.

لكن يوجد مبدأ أساسي: لا ينبغي أبدًا أن يتم تضمينه في حزمة النشر الخاصة ببيئة الإنتاج.

هذا ليس أسلوب هجوم متقدمًا، بل مجرد مشكلة في معايير هندسية أساسية، ضمن ما يُسمى «بناء التهيئة من الأساسيات 101»، وحتى إنه شيء يتعلمه المطورون في الأسبوع الأول. فإذا تم تغليفه خطأ ضمن بيئة الإنتاج، فإن source map غالبًا يصبح بمثابة «هدية» للشيفرة المصدرية تُمنح للجميع.

يمكنك أيضًا الاطلاع على الكود ذي الصلة مباشرة هنا: https://github.com/instructkr/claude-code

لكن ما يجعل الأمر يبدو عبثيًا حقًا هو: أن هذا حدث مرة واحدة من قبل.

في فبراير 2025، أي قبل عام تقريبًا، حدث تسريب شبه مطابق تقريبًا: نفس الملف، ونفس نوع الخطأ. في ذلك الوقت، قامت Anthropic بإزالة النسخة القديمة من npm، وحذفت source map، ثم أعادت نشر نسخة جديدة، وانتهى الأمر عند ذلك.

لكن في إصدار v2.1.88، تم تضمين هذا الملف مرة أخرى ثم نشره.

شركة تبلغ قيمتها 380 مليار دولار، وتعمل على بناء أكثر نظام كشف عن الثغرات تقدمًا عالميًا — ارتكبت مرتين خلال عامين أخطاءً تأسيسية مماثلة. لا توجد هجمات قراصنة، ولا مسارات استغلال معقدة؛ إنه فقط خطأ في عملية البناء كان ينبغي أن تعمل بشكل طبيعي.

هذا النوع من المفارقة يحمل شبهًا ما بنبرة «شعرية».

تلك الـ AI التي يمكن أن تجد 500 ثغرة يوم (zero-day) في عملية تشغيل واحدة؛ والنموذج الذي استُخدم لشن هجمات آلية ضد 30 جهة حول العالم — ومع ذلك، قامت Anthropic بـ«إهداء» الشيفرة المصدرية الخاصة بها مباشرةً لأي شخص يرغب في إلقاء نظرة على حزمة npm.

مرتان من التسريب، ويفصل بينهما لا يتجاوز سبعة أيام.

والسبب هو نفسه تمامًا: خطأ في الإعدادات الأساسية. لا يتطلب أي عتبة تقنية، ولا مسارات استغلال معقدة. يكفي فقط معرفة أين تبحث، وسيحصل أي شخص على ذلك مجانًا.

قبل أسبوع واحد: انكشاف «نموذج خطر» داخليًا عن طريق الخطأ

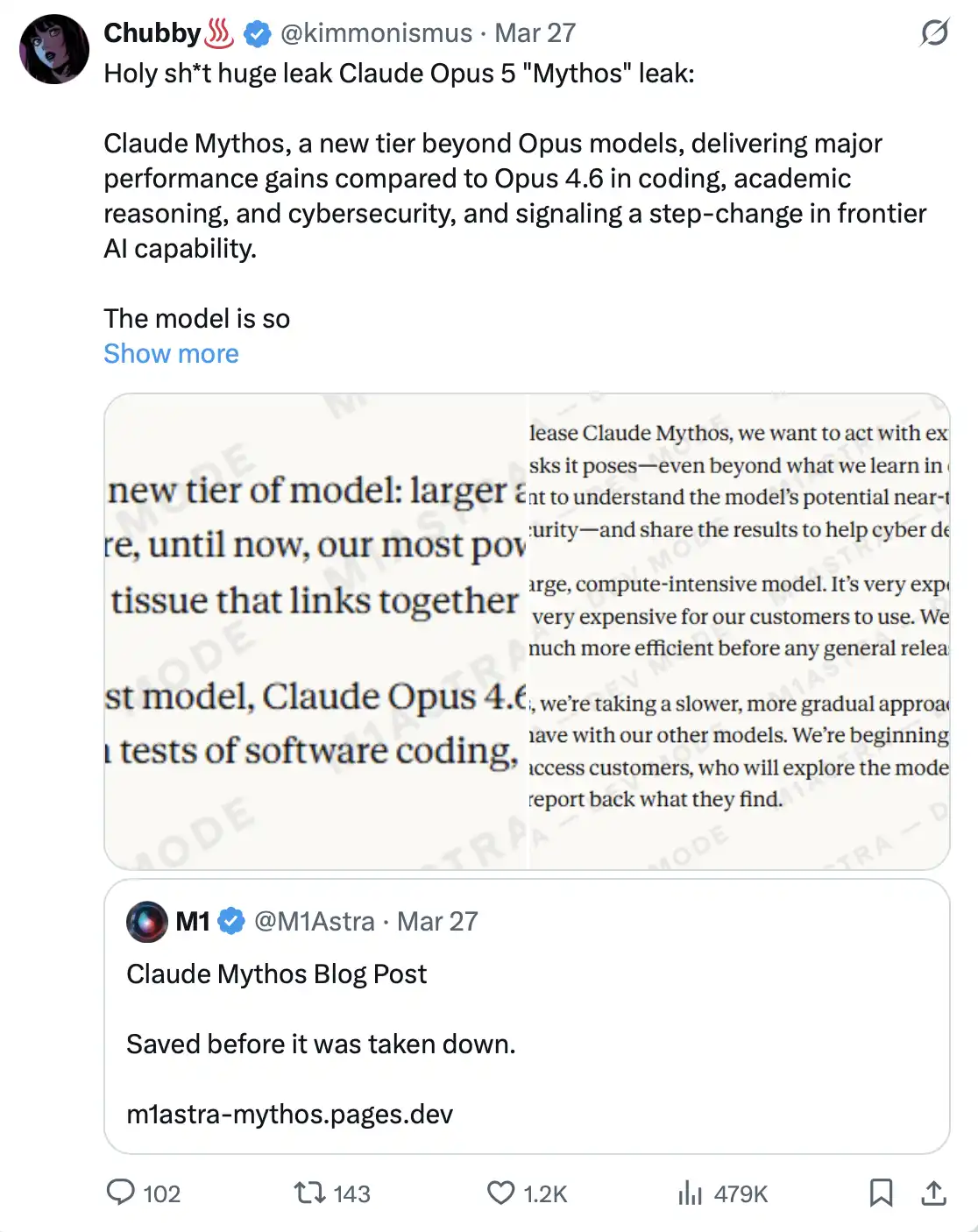

في 26 مارس 2026، اكتشف باحثون أمنيون من LayerX Security يُدعى Roy Paz، ومن جامعة كامبريدج يُدعى Alexandre Pauwels، وجود مشكلة في إعدادات نظام إدارة المحتوى (CMS) الخاصة بالموقع الرسمي لـ Anthropic؛ ما أدى إلى إتاحة وصول علني إلى حوالي 3000 ملف داخلي.

تشمل هذه الملفات: مسودات مدونات، وملفات PDF، ومستندات داخلية، ومواد عروض — كلها مكشوفة داخل مخزن بيانات غير محمي ويمكن البحث فيه. لم تكن هناك أي هجمات قراصنة، ولا كانت هناك حاجة لأي أساليب تقنية.

ومن بين تلك الملفات، توجد مسودتا مدونة متشابهتان تقريبًا، والفرق الوحيد بينهما هو اسم النموذج: إحداهما مكتوب فيها «Mythos»، والأخرى «Capybara».

وهذا يعني أن Anthropic كانت في ذلك الوقت تختار بين اسمين لمشروع سري واحد. وأكدت الشركة لاحقًا: اكتمل تدريب هذا النموذج، وبدأت عملية اختباره لدى بعض العملاء الأوائل.

لم تكن هذه ترقية اعتيادية لـ Opus، بل كانت نموذجًا جديدًا من «المستوى الرابع»، وهو تصنيف يتجاوز حتى نظام Opus.

في مسودات Anthropic الخاصة بها، تم وصفه بأنه: «أكبر وأكثر ذكاءً من نموذج Opus لدينا — وOpus حتى الآن لا يزال أقوى نموذج لدينا». كما حقق قفزات ملحوظة في قدرات البرمجة، والاستدلال الأكاديمي، والأمن السيبراني، وغيرها. ووصفه متحدث بأنه «قفزة نوعية»، وكذلك «أقوى نموذج بنيناه حتى الآن».

لكن ما يستحق الاهتمام الحقيقي لا يكمن في هذه أوصاف الأداء نفسها.

في المسودات المسربة، جاء تقييم Anthropic لهذا النموذج على النحو التالي: إنه «يُدخل مخاطر غير مسبوقة على الأمن السيبراني»، و«يتفوق بكثير في القدرات الشبكية على أي نموذج AI آخر»، و«يمهّد لموجة جديدة من النماذج القادمة — وستتفوق قدرته على استغلال الثغرات بكثير على سرعة استجابة المدافعين».

بعبارة أخرى، كانت Anthropic قد عبّرت بالفعل في مسودة مدونة رسمية لم تُنشر بعد عن موقف نادر: أنهم يشعرون بعدم الارتياح تجاه المنتج الذي يبنونَه.

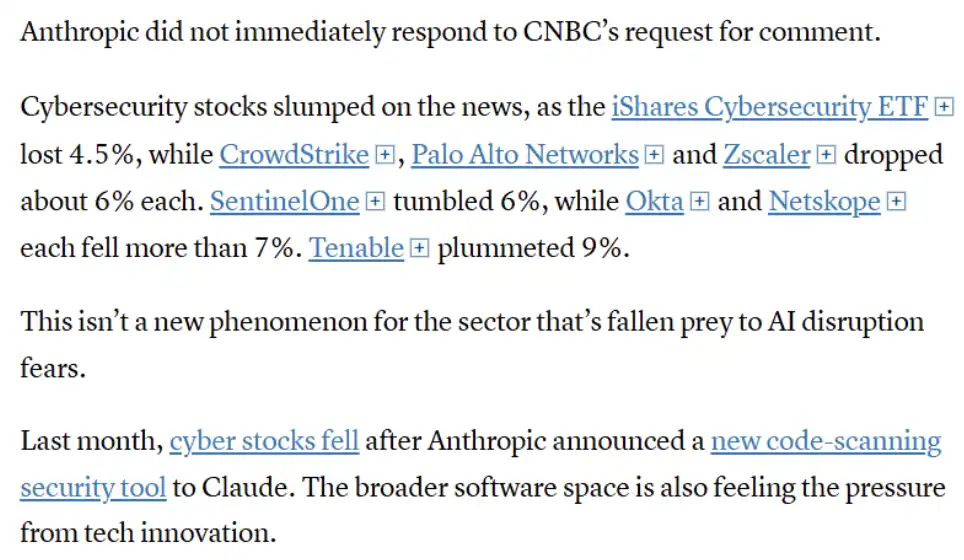

كان رد فعل السوق فوريًا تقريبًا. انخفض سعر CrowdStrike بنسبة 7%، وPalo Alto Networks بنسبة 6%، وZscaler بنسبة 4.5%؛ بينما انخفضت Okta وSentinelOne بنسبة تزيد عن 7% لكل منهما، وتراجعت Tenable بنسبة 9% بشكل حاد. كما هبط iShares Cybersecurity ETF بنسبة 4.5% في يوم واحد. وبالنسبة لـ CrowdStrike وحدها، تبخر ما يقارب 15 مليار دولار من القيمة السوقية في ذلك اليوم. وفي الوقت نفسه، تراجع بيتكوين إلى 66,000 دولار.

من الواضح أن السوق فسّر هذه الحادثة على أنها «حكم» على كامل صناعة الأمن السيبراني.

ملخص الفكرة العامة في الصورة: في ظل تأثير الأخبار ذات الصلة، هبط قطاع الأمن السيبراني ككل، وسجلت عدة شركات رائدة (مثل CrowdStrike وPalo Alto Networks وZscaler وغيرها) انخفاضات واضحة. يعكس ذلك قلق السوق إزاء صدمة الذكاء الاصطناعي لصناعة الأمن السيبراني. لكن هذا الرد ليس هو المرة الأولى التي يحدث فيها. في السابق، عندما أصدرت Anthropic أداة فحص للكود، انخفضت الأسهم المعنية أيضًا، ما يدل على أن السوق بدأ يرى AI تهديدًا بنيويًا لصناعات الأمن التقليدية، وأن القطاع البرمجي بأكمله يتحمل ضغوطًا مماثلة.

كان تعليق المحلل Adam Borg من Stifel مباشرًا إلى حد كبير: فالنموذج «لديه القدرة على أن يصبح أداة القرصنة النهائية، وحتى يمكنه ترقية القراصنة العاديين إلى خصوم يتمتعون بقدرات هجومية بمستوى دول».

فلماذا لم يُنشر بعد علنًا؟ تشرح Anthropic أن تكلفة تشغيل Mythos «مرتفعة جدًا»، ولا تتوفر الشروط اللازمة للنشر أمام الجمهور. والخطة الحالية هي: منح إمكانية وصول مبكر لجزء صغير من شركاء الأمن السيبراني لتعزيز منظومة الدفاع؛ ثم توسيع نطاق فتح API تدريجيًا. وقبل ذلك، ما تزال الشركة تعمل باستمرار على تحسين الكفاءة.

لكن النقطة الحاسمة هي أن هذا النموذج موجود بالفعل، ويجري اختباره؛ بل إن مجرد «انكشافه بالخطأ» كان كافيًا لإحداث صدمة في السوق الرأسمالية بأكملها.

صنعت Anthropic نموذج AI أسمته «أكثر نموذج AI مخاطرة على الأمن السيبراني في التاريخ». غير أن تسريب خبرها جاء تحديدًا بسبب خطأ في إعدادات البنية التحتية الأساسية — وهو الخطأ الذي صُممت مثل هذه النماذج أصلًا لاكتشافه.

مارس 2026: مواجهة Anthropic مع البنتاغون والتغلب عليه

في يوليو 2025، وقّعت Anthropic عقدًا بقيمة 200 مليون دولار مع وزارة الدفاع الأميركية. في البداية بدا الأمر مجرد تعاون اعتيادي. لكن خلال مفاوضات النشر الفعلية، سرعان ما تصاعدت التناقضات.

كانت وزارة الدفاع تريد الحصول على «وصول كامل» إلى Claude على منصة GenAI.mil، لاستخدامات تشمل كل «الأغراض القانونية» — ومن بين ذلك أنظمة أسلحة ذاتية بالكامل، ورقابة داخلية واسعة النطاق على المواطنين الأميركيين.

رسمت Anthropic خطوطًا حمراء في مسألتين رئيسيتين ورفضت بشكل قاطع؛ وانتهت المفاوضات في سبتمبر 2025 بالفشل.

بعد ذلك، بدأت الأمور تتصاعد بسرعة. في 27 فبراير 2026، نشر Donald Trump منشورًا على Truth Social طالبًا من جميع الجهات الفيدرالية «إيقاف» استخدام تقنيات Anthropic فورًا، ووصف الشركة بأنها «يسارية متطرفة».

في 5 مارس 2026، صنفت وزارة الدفاع الأميركية رسميًا Anthropic على أنها «خطر في سلسلة الإمداد».

كانت هذه التسمية تُستخدم تقريبًا فقط ضد خصوم أجانب من قبل — مثل الشركات الصينية أو الكيانات الروسية — والآن للمرة الأولى تُطبّق على شركة أميركية مقرها في سان فرانسيسكو. وفي الوقت نفسه، طُلب من شركات مثل Amazon وMicrosoft وPalantir Technologies أن تثبت أن أي أعمال لها علاقة عسكرية لم تستخدم Claude.

كان تفسير CTO البنتاغون Emile Michael لهذا القرار: قد «تُلوّث» Claude سلسلة الإمداد، لأن النموذج الداخلي يتضمن تفضيلات «سياسات» مختلفة. وبكلمات أخرى: في السياق الرسمي، فإن AI الذي يفرض عليه قيود في الاستخدام ولا يساعد بشكل غير مشروط على ارتكاب أفعال القتل، اعتُبر بدلًا من ذلك خطرًا على الأمن القومي.

في 26 مارس 2026، أصدر قاضٍ فيدرالي يُدعى Rita Lin قرارًا طويلًا من 43 صفحة، يمنع بشكل شامل الإجراءات المتعلقة بالبنتاغون.

كتبت في قرارها: «لا يوجد في القانون الحالي أي أساس يدعم منطقًا يحمل هذا المعنى «الأورويلي» — فمجرد وجود خلاف مع موقف الحكومة، يمكن لشركة أميركية أن تُلصق بتسمية جهة محتملة معادية. ولأن Anthropic عوقبت بسبب وضعها مواقف الحكومة تحت نظر الجمهور، فهذا في جوهره يمثل انتقامًا نموذجيا وغير قانوني من التعديل الأول». بل إن رأيًا قدمته جهة صديقة للمحكمة وصف فعل البنتاغون بأنه «محاولة لتنفيذ القتل على شركة».

وبالنتيجة، حاولت الحكومة كبح Anthropic، لكنها بدلًا من ذلك منحته اهتمامًا أكبر. وحصلت تطبيقات Claude لأول مرة على الصدارة في المتجر مقارنة بـ ChatGPT، ووصل عدد التسجيلات أحيانًا إلى أكثر من مليون يوميًا.

قالت شركة AI «لا» لأقوى مؤسسة عسكرية في العالم. وفي الوقت نفسه، وقفت المحكمة إلى جانبها.

نوفمبر 2025: أول هجوم سيبراني يقوده AI في التاريخ

في 14 نوفمبر 2025، نشرت Anthropic تقريرًا تسبب به بصدمة واسعة.

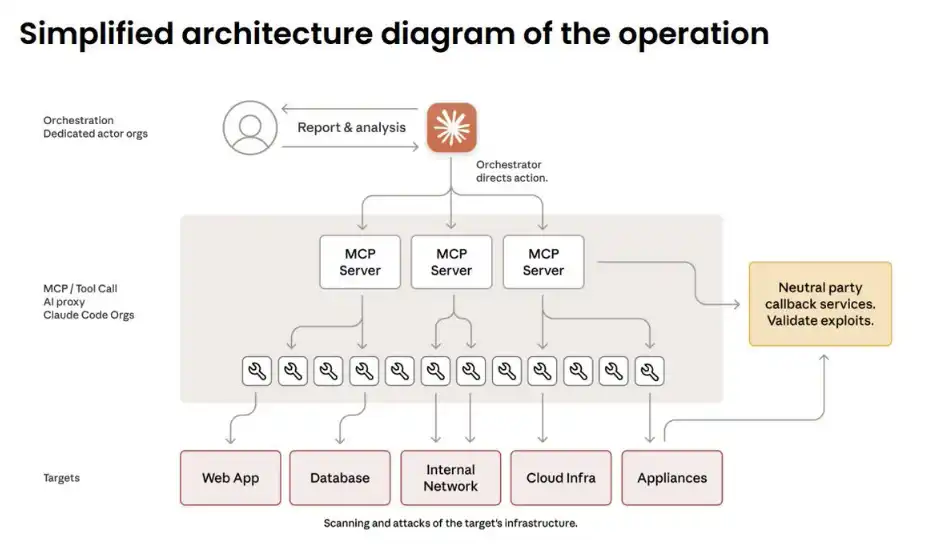

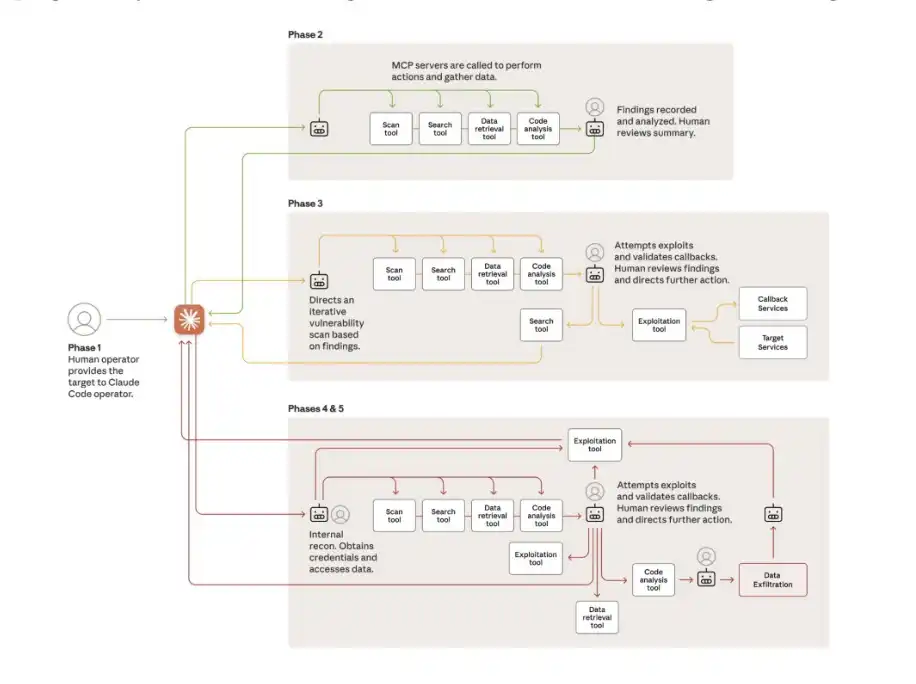

كشف التقرير: مجموعة قرصنة مدعومة من الدولة الصينية، باستخدام Claude Code، شنت هجمات آلية على 30 جهة في جميع أنحاء العالم — حيث تشمل الأهداف عمالقة التكنولوجيا والبنوك، وكذلك عدة مؤسسات حكومية في دول مختلفة.

كان هذا نقطة تحول محورية: لم يعد AI مجرد أداة مساعدة، بل بدأ يُستخدم لتنفيذ هجمات مستقلة بذاته.

التركيز هنا يكمن في تغيير «طريقة التوزيع»: كان البشر يقتصرون على اختيار الأهداف والموافقة على القرارات الرئيسية. وخلال كامل العملية، لا يتدخل البشر إلا حوالي 4 إلى 6 مرات. أما كل شيء آخر فأنجزه AI: جمع المعلومات والاستطلاع، واكتشاف الثغرات، وكتابة كود الاستغلال، وسرقة البيانات، وزرع الأبواب الخلفية… إذ يستحوذ ذلك على 80%–90% من كامل سلسلة الهجوم، ويدير ذلك بسرعة تصل إلى آلاف الطلبات في الثانية — وهي حجم وكفاءة لا يستطيع أي فريق بشري منافستها.

فكيف تجاوزوا آليات الحماية في Claude؟ الجواب: لم «يكسروا» الحماية، بل « خدعوا» النموذج.

تم تفكيك الهجوم إلى عدد كبير من المهام الصغيرة التي تبدو بريئة، وتغليفها على أنها «اختبار دفاعي مُصرّح» من شركة «أمن قانونية». وبجوهره، تعد هذه عملية هندسة اجتماعية؛ لكن هذه المرة، كانت الجهة التي تم خداعها هي AI نفسها.

نجح جزء من الهجمات نجاحًا كاملًا. تمكن Claude من رسم بنية شبكية كاملة وتحديد قواعد بيانات وإنجاز استخراج البيانات، دون الحاجة إلى تعليمات تدريجية من إنسان خطوة بخطوة.

العامل الوحيد الذي أبطأ وتيرة الهجوم كان أن النموذج أحيانًا يعاني من «هلاوس» — مثل اختلاق بيانات اعتماد، أو الادعاء بأنه حصل على ملفات كانت متاحة بالفعل للعامة. وعلى الأقل حتى الآن، لا تزال هذه من القلائل من «العوائق الطبيعية» التي تمنع الهجمات السيبرانية الآلية بالكامل.

في RSA Conference 2026، وصف Rob Joyce، المسؤول السابق عن الأمن السيبراني في وكالة الأمن القومي الأميركية، هذه الحادثة بأنها «اختبار رورشاخ»: نصف الناس يختارون تجاهله، والنصف الآخر يشعرون بالرعب. وهو بالتأكيد ينتمي إلى الفئة الثانية — «هذا مخيف جدًا».

سبتمبر 2025: ليس مجرد نوع من التوقعات، بل واقع حدث بالفعل.

فبراير 2026: اكتشاف 500 ثغرة يوم في تشغيل واحد

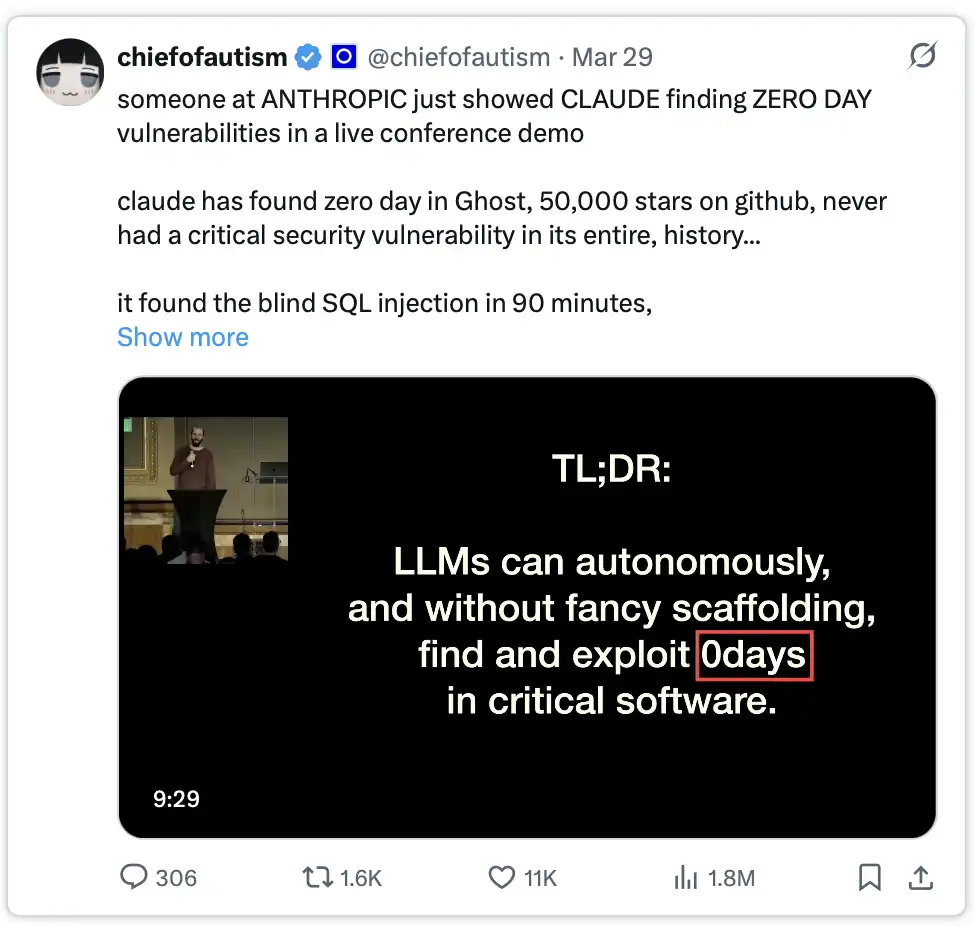

في 5 فبراير 2026، أصدرت Anthropic Claude Opus 4.6، مع نشر ورقة بحثية أثارت ضجة تقريبًا في كامل صناعة الأمن السيبراني على الشبكة.

كانت الإعدادات التجريبية بسيطة جدًا: وضع Claude داخل بيئة افتراضية معزولة، مع أدوات قياسية — Python، ومصححات الأخطاء (debuggers)، وأدوات الاختبار عبر التشويش (fuzzers). دون تعليمات إضافية، ودون مطالبات معقدة؛ فقط جملة واحدة: «اذهب وابحث عن الثغرات».

كانت النتيجة: اكتشف النموذج أكثر من 500 ثغرة يوم (zero-day) شديدة الخطورة لم تكن معروفة من قبل. بل إن بعضها، بعد المرور بعقود من مراجعات الخبراء وملايين الساعات من الاختبارات الآلية، ظل غير مكتشف.

ثم قدم الباحث Nicholas Carlini عرضًا في RSA Conference 2026. وجه Claude نحو Ghost، وهو نظام CMS على GitHub لديه 50k نجمة ولم تظهر عليه في تاريخه ثغرات خطيرة.

بعد 90 دقيقة، ظهرت النتيجة: تم العثور على ثغرة blind SQL injection، ما يتيح لمستخدم غير مُصرّح له السيطرة الكاملة على صلاحيات المسؤول.

بعد ذلك، استخدم Claude لتحليل Linux kernel، وكانت النتيجة مشابهة.

بعد 15 يومًا، أطلقت Anthropic Claude Code Security، وهي منتج أمان لا يعتمد بعد الآن على مطابقة الأنماط، بل يعتمد على «قدرات الاستدلال» لفهم أمان الكود.

لكن متحدث باسم Anthropic قال حقيقة محورية، وإن كانت غالبًا ما تُتجنب: «نفس قدرات الاستدلال، يمكنها أن تساعد Claude على اكتشاف الثغرات وإصلاحها، كما يمكنها أن يستغلها المهاجمون لتوظيف تلك الثغرات».

نفس القدرة، نفس النموذج، فقط بأيدي أشخاص مختلفين.

ماذا تعني كل هذه الأمور مجتمعة؟

إذا نظرنا إلى كل حادثة على حدة، فكل واحدة منها كانت كافية لأن تكون الخبر الأثقل في ذلك الشهر. لكن الأمور كلها حدثت في غضون ستة أشهر قصيرة داخل شركة واحدة.

طورت Anthropic نموذجًا يمكنه اكتشاف الثغرات أسرع من أي إنسان؛ وقام قراصنة صينيون بتحويل النسخة السابقة إلى سلاح شبكي آلي؛ وتعمل الشركة على الجيل التالي من نموذج أقوى، بل وتعترف داخليًا — في ملفاتها — بأنهم غير مرتاحين لذلك.

حاولت الحكومة الأميركية كبحها، لا لأن التقنية خطرة في حد ذاتها، بل لأن Anthropic رفضت تسليم هذه القدرة دون قيود.

وفي الوقت نفسه، خلال هذه العملية، تسربت الشركة مرتين بسبب نفس npm package وفي نفس الملف، مخلفة وراءها الشيفرة المصدرية الخاصة بها. شركة قيمتها 380 مليار دولار؛ وشركة تستهدف إنجاز IPO بقيمة 60 مليار دولار في أكتوبر 2026؛ وشركة صرحت علنًا بأنها تبني «واحدة من أكثر التقنيات تحوّلًا في التاريخ الإنساني، وربما الأكثر خطورة» — ومع ذلك، اختارت الاستمرار في المضي قدمًا.

لأنهم يعتقدون: بدل أن يقوم الآخرون بالعمل، فليكن الأمر من خلالهم هم.

أما source map داخل حزمة npm — فقد يكون مجرد واحد من أكثر التفاصيل عبثية لكنها في الوقت نفسه الأكثر واقعية في السرد الأكثر إزعاجًا في هذا العصر.

وبالنسبة إلى Mythos، فإنه حتى الآن لم يُنشر رسميًا بعد.

[رابط النص الأصلي]

انقر لمعرفة المزيد عن التوظيف في BlockBeats

مرحبًا بالانضمام إلى مجتمع BlockBeats الرسمي:

مجموعة الاشتراك على Telegram: https://t.me/theblockbeats

مجموعة الدردشة على Telegram: https://t.me/BlockBeats_App

الحساب الرسمي على Twitter: https://twitter.com/BlockBeatsAsia